研究人员利用GPT4-Vision构建了一个大规模高质量图文数据集ShareGPT4V,并在此基础上训练了一个7B模型,在多项多模态榜单上超越了其他同级模型。

OpenAI在九月份为ChatGPT添加了图像输入功能,允许用户使用上传一张或多张图像配合进行对话,这一新兴功能的背后是一个被OpenAI称为GPT4-Vision的多模态(vision-language)大模型。

鉴于OpenAI对「闭源」的坚持,多模态开源社区如雨后春笋般涌出了众多优秀的多模态大模型研究成果,例如两大代表作MiniGPT4和LLaVA已经向用户们展示了多模态对话和推理的无限可能性。

在多模态大模型(Large Multi-modal Models)领域,高效的模态对齐(modality alignment)是至关重要的,但现有工作中模态对齐的效果却往往受制于缺少大规模的高质量的「图像-文本」数据。

为了解决这一瓶颈,近日,中科大和上海AI Lab的研究者们最近推出了具有开创性意义的大型图文数据集ShareGPT4V。

论文地址:https://arxiv.org/abs/2311.12793

Demo演示:https://huggingface.co/spaces/Lin-Chen/ShareGPT4V-7B

项目地址:https://github.com/InternLM/InternLM-XComposer/tree/main/projects/ShareGPT4V

ShareGPT4V数据集包含120万条「图像-高度详细的文本描述」数据,囊括了了世界知识、对象属性、空间关系、艺术评价等众多方面,在多样性和信息涵盖度等方面超越了现有的数据。

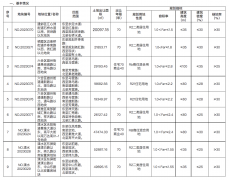

表1 ShareGPT4V和主流标注数据集的比较。其中「LCS」指LAION, CC和SBU数据集,「Visible」指明了图片在被标注时是否可见,「Avg.」展示了文本描述的平均英文字符数。

目前,该数据集已经登上了Hugging Face Datasets Trending排行第一。