由 ChatGPT 掀起的这场 AI 革命,令人们感慨神奇的同时,也不禁发出疑问:AI 究竟是怎么做到这一切的?

此前,即便是专业的数据科学家,都难以解释大模型(LLM)运作的背后。而最近,OpenAI 似乎做到了——本周二,OpenAI 发布了其最新研究:让 GPT-4 去试着解释 GPT-2 的行为。

即:让一个 AI “黑盒”去解释另一个 AI “黑盒”。

工作量太大,决定让 GPT-4 去解释 GPT-2

OpenAI 之所以做这项研究的原因,在于近来人们对 AI 伦理与治理的担忧:“语言模型的能力越来越强,部署也越来越广泛,但我们对其内部工作方式的理解仍然非常有限。”

由于 AI 的“黑盒”性质,人们很难分辨大模型的输出结果是否采用了带有偏见性质的方法,也难以区分其正确性,因而“可解释性”是亟待重要的一个问题。

AI 的发展很大程度上是在模仿人类,因而大模型和人脑一样,也由神经元组成,它会观察文本规律进而影响到输出结果。所以想要研究 AI 的“可解释性”,理论上要先了解大模型的各个神经元在做什么。

按理来说,这本应由人类手动检查,来弄清神经元所代表的数据特征——参数量少还算可行,可对于如今动辄百亿、千亿级参数的神经网络,这个工作量显然过于“离谱”了。

于是,OpenAI 灵机一动:或许,可以用“魔法”打败“魔法”?

“我们用 GPT-4 为大型语言模型中的神经元行为自动编写解释,并为这些解释打分。”而 GPT-4 首次解释的对象是 GPT-2,一个 OpenAI 发布于 4 年前、神经元数量超过 30 万个的开源大模型。

让 GPT-4 “解释” GPT-2 的原理

具体来说,让 GPT-4 “解释” GPT-2 的过程,整体分为三个步骤。

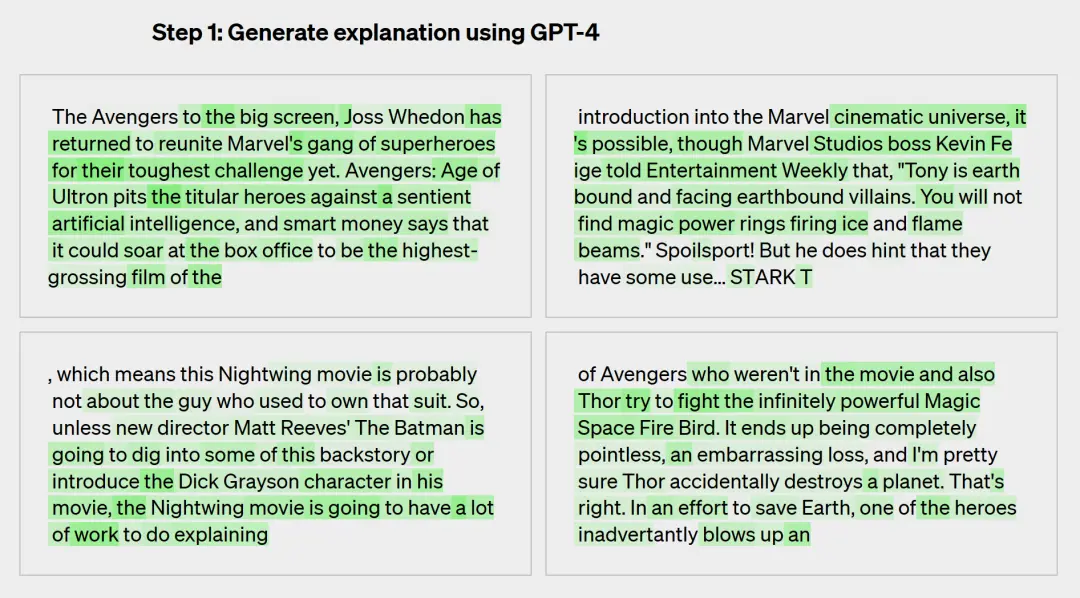

(1)首先,让 GPT-4 生成解释,即给出一个 GPT-2 神经元,向 GPT-4 展示相关的文本序列和激活情况,产生一个对其行为的解释。

如上图所示,GPT-4 对 GPT-2 该神经元生成的解释为:与电影、人物和娱乐有关。

(2)其次,再次使用 GPT-4,模拟被解释的神经元会做什么。下图即 GPT-4 生成的模拟内容。